Une main artificielle combine contrôles humain et robotique

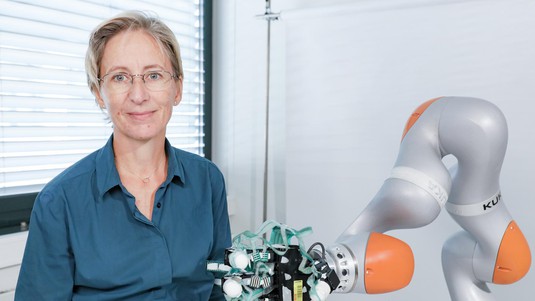

Les scientifiques de l’EPFL ont testé avec succès une nouvelle technologie neuroprosthétique qui combine robotique et mouvements volontaires de l’utilisateur. Ces travaux ouvrent de nouvelles perspectives dans le domaine émergent et interdisciplinaire des contrôles partagés pour les neuroprothèses.

A l’EPFL, des scientifiques développent de nouvelles approches pour perfectionner la saisie des mains robotisées, à l’intention notamment des personnes amputées. Leur méthode associe le contrôle individuel des doigts et l’automatisation, afin d’améliorer la prise et la manipulation. Trois patients amputés et sept sujets bien-portants ont participé à une démonstration de faisabilité, à la frontière de la neuroingénierie et de la robotique. Les résultats sont publiés aujourd’hui dans Nature Machine Intelligence.

Cette technologie associe deux concepts issus de spécialités distinctes. Cette double implémentation est une première dans le domaine du contrôle des mains robotisées. Elle s’inscrit dans le champ émergent des contrôles partagés en neuroprosthétique.

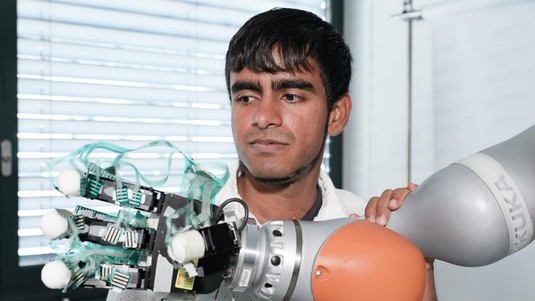

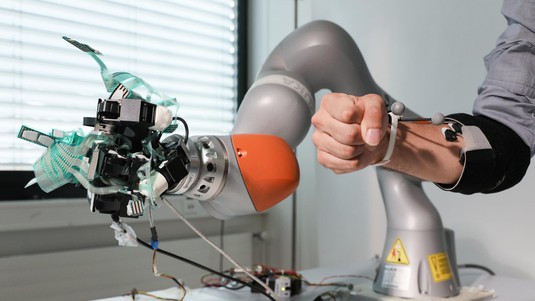

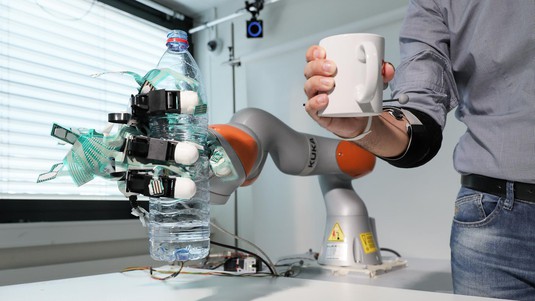

Le premier concept provient de la neuroingénierie: il s’agit de déchiffrer les mouvements envisagés par le patient à partir de l’activité musculaire du moignon, et de contrôler individuellement les doigts. Cela n’avait jamais été réalisé auparavant. Le second concept dérive de la robotique: la main artificielle assiste le patient dans la prise des objets et maintient le contact pour assurer une saisie ferme.

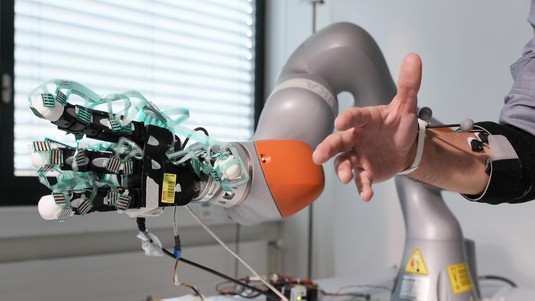

“Quand vous saisissez un objet dans la main et qu’il commence à vous échapper, vous n’avez que quelques millisecondes pour réagir”, explique Aude Billard, directrice du Laboratoire d'algorithmes et systèmes d'apprentissage à l’EPFL. “Notre main robotique peut intervenir dans les 400 millisecondes. Equipée de capteurs de pression le long des doigts, elle réagit et stabilise la saisie avant même que le cerveau perçoive le glissement de l’objet.”

Comment fonctionnent les contrôles partagés

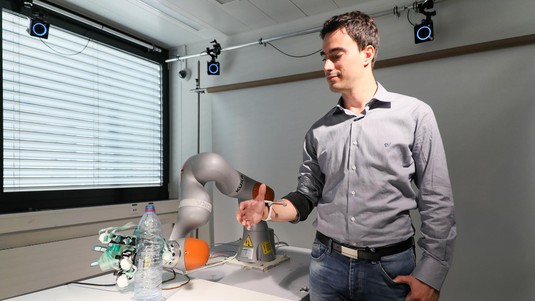

L’algorithme apprend d’abord comment décrypter l’intention de l’utilisateur, pour la traduire en mouvements sur les doigts de la prothèse. Le sujet amputé doit réaliser une série de mouvements de la main afin d’entraîner l’algorithme, qui repose sur des principes d’apprentissage automatisé. Placés sur le moignon du patient, des capteurs détectent les signaux provenant des muscles. L’algorithme apprend quel mouvement de la main correspond à quel type d’activité musculaire. Une fois déchiffrés les mouvements que souhaite exécuter l’utilisateur, l’information peut être exploitée pour contrôler individuellement les doigts de la prothèse.

“Les signaux qui proviennent des muscles peuvent être difficiles à interpréter, explique Katie Zhuang, première auteure de l’étude. Nous avons donc besoin d’un algorithme d’apprentissage automatique qui distingue l’activité musculaire pertinente et la traduit en mouvements.”

Enfin, les scientifiques ont modifié l’algorithme pour que l’automatisation robotique prenne le relais quand l’utilisateur tente de saisir quelque chose. L’algorithme ordonne à la prothèse de refermer ses doigts quand les capteurs, distribués sur la surface, entrent en contact avec un objet. Cette saisie automatique est adaptée de précédents travaux sur les bras robotisés, conçus pour déduire la forme des objets et les agripper sur la base exclusive d’informations tactiles – sans apports de signaux visuels.

Il reste encore de nombreux défis à relever avant que l’algorithme puisse être implémenté sur une prothèse de main disponible pour les personnes amputées. Aujourd’hui, il est encore testé sur un robot fourni par un tiers.

“Notre approche combinée pour contrôler les mains robotiques revêt un potentiel dans de nombreuses applications en neuroprosthétique, telles que les prothèses de main bioniques ou les interfaces cerveau-machine. Elle renforce l’impact clinique et les usages potentiels de ces dispositifs”, explique Silvestro Micera, titulaire de la Chaire de la Fondation Bertarelli en neuroingénierie translationnelle et professeur de bioélectronique à l’Ecole supérieure Sant’Anna.

NCCR Robotics. Bertarelli Foundation.