Chantonner dans sa tête, une véritable énigme scientifique

© iStock

Des chercheurs de l’EPFL ont pu analyser le fonctionnement du cerveau nous permettant d’entendre intérieurement un air de musique. A terme, les scientifiques espèrent pouvoir appliquer leurs résultats pour aider les personnes ayant perdu l’usage de la parole.

Lorsque nous entendons de la musique, différentes parties du cerveau traitent différentes informations, comme les hautes ou les basses fréquences, et nous permettent de percevoir les sons tels que nous les entendons. L’activité cérébrale durant ce processus peut facilement être étudiée, quand une personne écoute une chanson par exemple. Il existe des technologies pour enregistrer les réponses neuronales produites à chacun des sons entendus, et les analyser. Par contre, comprendre l’activité cérébrale lorsque nous nous chantons intérieurement un air, et donc sans stimulation auditive, se révèle beaucoup plus compliqué. Pour y parvenir, il faudrait pouvoir relier les réponses du cerveau à un son donné, comme dans l’expérience précédente. Or dans le cas de la musique interne, ce son n’existe pas, ou en tout cas pas pour nos oreilles. Grâce à une expérience unique, des chercheurs de la Chaire Fondation Defitech en interface cerveau-machine de l’EPFL ont pu analyser le fonctionnement du cerveau nous permettant de chantonner intérieurement un air de musique.

Enregistrer un son imaginé

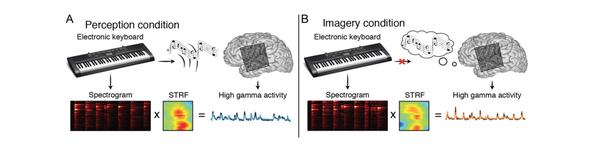

Les chercheurs de l’EPFL en collaboration avec l’Université de Berkeley ont travaillé avec un patient épileptique, par ailleurs pianiste chevronné. Lors d’une première expérience, il a joué une pièce de musique sur un piano électronique, avec le son activé. Le morceau et l’activité cérébrale correspondante ont été enregistrés. Lors d’une seconde expérience, les chercheurs ont demandé au patient de rejouer le même morceau en s’imaginant la musique intérieurement et ont coupé le son du piano. A nouveau, l’activité du cerveau et le morceau ont été enregistrés. A la différence près que cette fois-ci, la musique jouée découlait uniquement de la représentation mentale que s’en faisait le patient, étant donné que les notes produites étaient inaudibles. En récoltant des informations dans les deux conditions, les chercheurs ont ainsi pu relier l’activité cérébrale produite en fonction des sons, et ont pu comparer les données.

Une expérience unique

L’expérience peut paraître semble simple. En réalité, elle est unique. «La technique utilisée, l’électrocorticographie, est très invasive. Elle consiste à implanter des électrodes assez profondément dans la boîte crânienne du patient», explique Stéphanie Martin, auteure principale de cette étude et doctorante à la Chaire Fondation Delfitech en interface cerveau-machine. «Elle est généralement utilisée dans le traitement de l’épilepsie, pour des malades qui ne supporteraient pas les médicaments.» C’est d’ailleurs pour cette raison que les chercheurs ont travaillé avec ce patient en particulier. Hors traitement, cette technique permet de mesurer les réponses cérébrales dans une très bonne résolution spatiale et temporelle, une nécessité vu la rapidité des réponses neuronales.

Schéma de l'expérience. (A) Le participant joue un morceau sur le piano électronique, avec le son. (B) Le participant joue le même morceau, mais le son du piano est éteint et le pianiste doit imaginer la musique correspondante intérieurement. Dans les deux cas, le son produit par le piano est enregistré, ainsi que les réponses neuronales.

De futures applications pour le langage?

Pour la première fois, une étude permet ainsi de démontrer que dans le cas de la musique imaginée, le cortex auditif et les différentes parties du cerveau traitent des informations auditives, par exemple les hautes et basses fréquences, comme elles le feraient s’ils étaient stimulée par des sons. Les détails sont publiés dans le journal Cerebral Cortex. Les chercheurs ont pu cartographier les parties du cerveau couvertes par les électrodes selon leur fonction dans ce processus et leurs réactions aux sons audibles et imaginés. L’objectif des scientifiques serait de pouvoir appliquer ces résultats au langage, par exemple pour les personnes ayant perdu la parole. «La recherche en est vraiment à ses début. Le langage est un système beaucoup plus compliqué que la musique, qui implique de nombreuses étapes de traitement, pour des informations linguistiques et donc non-universelles», prévient Stéphanie Martin. «La méthode d’enregistrement est invasive, la technologie devra progresser afin de mesurer de façon plus fiable l’activité cérébrale.» Si les recherches doivent donc encore continuer, une première étape pour les chercheurs sera de répliquer ces résultats avec des patients aphasiques, c’est-à-dire présentant des troubles du langage, et voir si les sons qu’ils imaginent peuvent être recréés. Dans le futur, les scientifiques espèrent pouvoir utiliser leurs résultats auprès de personnes ayant perdu l’usage de la parole, en «lisant» leur discours interne et en le reproduisant vocalement.

«Neural Encoding of Auditory Features during Music Perception and Imagery». Stephanie Martin, Christian Mikutta, Matthew K. Leonard, Dylan Hungate, Stefan Koelsch, Shihab Shamma, Edward F. Chang, José del R. Millán, Robert T. Knight, Brian N. Pasley

Cette étude a été réalisée en collaboration avec les institutions suivantes : University of California, Berkeley ; University Hospital of Psychiatry, Bern ; Inselspital, Bern ; University of California, San Francisco ; Freie Universität, Berlin ; École normale supérieure, Paris ; University of Maryland in College Park, USA